Das Komponentenmodellieren dient als Rückgrat der Dokumentation von Softwarearchitekturen. Es bietet eine visuelle Darstellung der strukturellen Organisation eines Systems und definiert, wie sich einzelne Teile zur Erbringung von Funktionalität verhalten. Da sich die technologischen Landschaften rasch verändern, unterliegen die Methoden zur Modellierung dieser Komponenten einer erheblichen Transformation. Architekten und Ingenieure müssen über entstehende Muster informiert bleiben, um die Integrität und Anpassungsfähigkeit des Systems zu gewährleisten.

Dieser Leitfaden untersucht die Entwicklung des Komponentenmodellierens. Wir analysieren, wie Automatisierung, künstliche Intelligenz und verteilte Systeme die Art und Weise verändern, wie wir Softwarestrukturen entwerfen und dokumentieren. Das Verständnis dieser Veränderungen ermöglicht es Teams, Systeme zu entwickeln, die widerstandsfähig, skalierbar und im Laufe der Zeit einfacher zu pflegen sind.

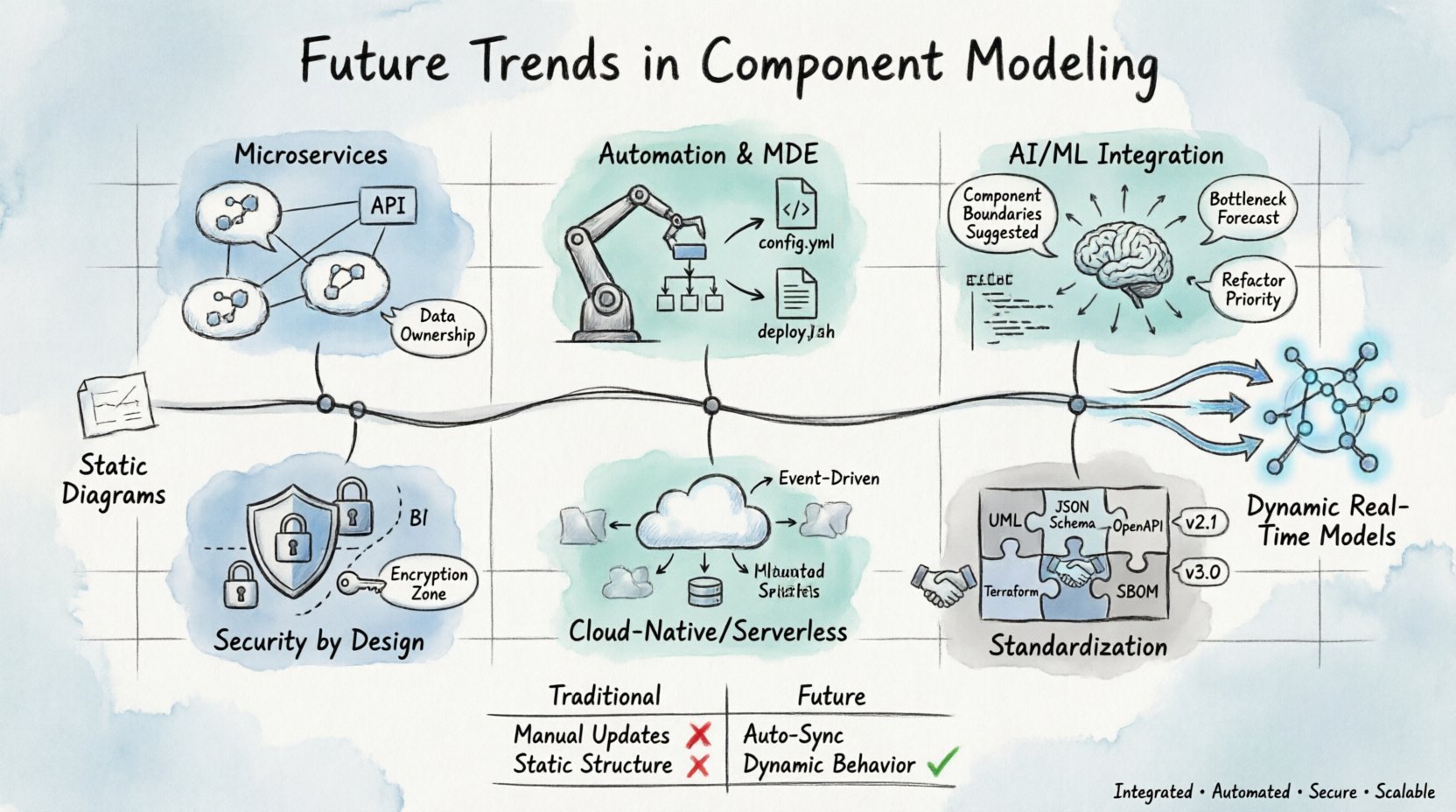

Die Entwicklung statischer Diagramme ⏳

Traditionell waren Komponentendiagramme statische Schnappschüsse. Sie zeigten den Zustand eines Systems zu einem bestimmten Zeitpunkt. Architekten erstellten diese Visualisierungen, um hochrangige Entwurfsentscheidungen an Stakeholder weiterzugeben. Obwohl sie für die ursprüngliche Planung effektiv waren, wurden statische Modelle oft schnell veraltet, während sich die Codebasis weiterentwickelte.

Die Diskrepanz zwischen Dokumentation und Implementierung führte zu technischem Schulden. Teams verbrachten zu viel Zeit damit, Diagramme an die Realität des Codes anzupassen. Diese Wartungsbelastung führte oft dazu, dass die Dokumentation gänzlich ignoriert wurde. Moderne Trends beheben dies, indem das Modellieren direkt in den Entwicklungslebenszyklus integriert wird.

- Dynamische Visualisierung: Modelle spiegeln nun Zustände des Systems in Echtzeit wider, anstatt theoretische Entwürfe darzustellen.

- Integration in Versionskontrollsysteme: Diagrammversionen werden gemeinsam mit Quellcode-Commits verfolgt.

- Live-Datenbindung: Modell-Elemente ziehen Daten aus laufenden Umgebungen, um Genauigkeit zu gewährleisten.

Durch die Abkehr von statischer Dokumentation verringern Teams die Spannung zwischen Entwurf und Umsetzung. Ziel ist es, eine einzige Quelle der Wahrheit aufrechtzuerhalten, die ohne manuelle Intervention genau bleibt.

Mikrodienste und verteilte Grenzen 🌐

Der Wechsel hin zu einer Mikrodienste-Architektur hat die Komponentengrenzen grundlegend verändert. In monolithischen Systemen waren Komponenten oft lose gekoppelte Module innerhalb eines einzigen Prozesses. In verteilten Systemen stellen Komponenten unabhängige Dienste dar, die über Netzwerke kommunizieren.

Das Modellieren dieser Grenzen erfordert ein tieferes Verständnis von Netzwerk-Latenz, Fehlertoleranz und Datenkonsistenz. Die visuelle Darstellung einer Komponente muss nun Informationen über ihre Bereitstellungsumgebung, Kommunikationsprotokolle und Sicherheitsbeschränkungen enthalten.

Wichtige Überlegungen beim Modellieren verteilter Komponenten sind:

- Dienstverträge:Definition klarer Schnittstellen zwischen Diensten, um eine enge Kopplung zu vermeiden.

- Dateneigentum:Identifizieren, welche Komponente bestimmte Datensätze besitzt, um Doppelungen zu vermeiden.

- Ausfallzustände:Visualisieren, wie sich Komponenten verhalten, wenn Abhängigkeiten ausfallen.

Architekten müssen die Infrastruktur-Ebene als Teil der Komponentenstruktur modellieren. Dazu gehören Lastverteilungssysteme, Nachrichtenwarteschlangen und API-Gateways. Die Behandlung der Infrastruktur als erstklassiges Element im Modellieren stellt sicher, dass Skalierbarkeit und Resilienz bereits von Beginn an in das System integriert werden.

Automatisierung und modellgetriebene Entwicklung 🤖

Manuelles Modellieren ist anfällig für menschliche Fehler und Inkonsistenzen. Die modellgetriebene Entwicklung (MDE) automatisiert die Erstellung von Artefakten aus hochwertigen Modellen. Dieser Ansatz verringert das Risiko von Abweichungen zwischen dem Entwurf und der tatsächlichen Implementierung.

Die Automatisierung ermöglicht die Generierung von Standardcode, Konfigurationsdateien und Bereitstellungsskripten direkt aus Komponentenmodellen. Dies vereinfacht den Entwicklungsprozess und ermöglicht es Ingenieuren, sich auf die Geschäftslogik zu konzentrieren, anstatt sich mit wiederholten Einrichtungsaufgaben zu beschäftigen.

Vorteile der Automatisierung im Modellieren umfassen:

- Konsistenz:Automatisierte Prozesse wenden die gleichen Regeln auf alle generierten Artefakte an.

- Geschwindigkeit:Die Codegenerierung erfolgt sofort und beschleunigt die Iterationszyklen.

- Validierung:Modelle können vor der Erstellung jeglichen Codes gegen architektonische Regeln validiert werden.

Je besser die Werkzeuge werden, desto mehr verschwimmt die Grenze zwischen Modellierung und Codierung. Ingenieure könnten feststellen, dass sie Systeme in einer visuellen Umgebung entwerfen, die direkt in produktionsfähige Infrastruktur kompiliert wird. Dies verringert die kognitive Belastung, die beim Wechsel zwischen Designwerkzeugen und Codierumgebungen entsteht.

KI- und Maschinenlernintegration 🧠

Künstliche Intelligenz beginnt, die Erstellung und Pflege von Komponentenmodellen zu beeinflussen. Maschinenlernalgorithmen können bestehende Codebasen analysieren, um optimale Komponentenstrukturen vorzuschlagen. Sie erkennen Muster im Datenfluss durch ein System und empfehlen Grenzen, die die Kopplung minimieren.

KI-getriebene Modellierungstools können auch potenzielle Engpässe vorhersagen. Durch die Analyse historischer Leistungsdaten schlägt das System vor, wo Caching-Ebenen hinzugefügt oder die Redundanz erhöht werden sollte. Dieser proaktive Ansatz hilft Architekten, Leistungsprobleme zu behandeln, bevor sie die Benutzer beeinträchtigen.

Mögliche Anwendungen von KI in der Modellierung umfassen:

- Automatisiertes Refactoring:Vorschläge für Komponentensplitting oder -zusammenführung basierend auf Komplexitätsmetriken.

- Abhängigkeitsanalyse:Verborgene Abhängigkeiten visualisieren, die im Code nicht sofort erkennbar sind.

- Compliance-Prüfung:Automatisches Kennzeichnen von Komponenten, die Sicherheits- oder regulatorische Standards verletzen.

Während KI das menschliche Urteilsvermögen nicht ersetzt, liefert sie wertvolle Erkenntnisse, die architektonische Entscheidungen leiten. Die Rolle des Architekten verschiebt sich von der Erstellung von Diagrammen hin zur Validierung und Verfeinerung der Empfehlungen intelligenten Systeme.

Sicherheit und Compliance von Anfang an 🔒

Sicherheit ist kein nachträglicher Zusatz am Ende der Entwicklung mehr. Sie muss in das Komponentenmodell selbst eingebettet werden. Regulatorische Anforderungen und Sicherheitsbest Practices müssen als strukturelle Einschränkungen innerhalb des Diagramms dargestellt werden.

Zukünftige Modellierungsstandards werden wahrscheinlich explizite Definitionen von Vertrauensgrenzen erfordern. Jede Komponente muss ihre Datenverarbeitungsrichtlinien und Zugriffssteuerungen angeben. Diese Transparenz ermöglicht es Sicherheitsteams, die Architektur zu prüfen, ohne jede Codezeile einzeln überprüfen zu müssen.

Wichtige Elemente der Sicherheitsmodellierung umfassen:

- Authentifizierungsabläufe:Visualisierung, wie Identitäten über Komponentengrenzen hinweg verifiziert werden.

- Verschlüsselungsgebiete:Markierung von Bereichen, in denen Daten im Transit oder im Ruhezustand verschlüsselt werden müssen.

- Pfade zur Rechtemehrung:Darstellung, wie Zugriffsrechte zwischen Komponenten bewegt werden.

Die Integration von Sicherheit in das Modell stellt sicher, dass die Compliance während des gesamten Systemlebenszyklus gewährleistet ist. Es vereinfacht den Prüfungsprozess und verringert das Risiko, dass Sicherheitslücken während der Entwicklung übersehen werden.

Cloud-native und serverlose Überlegungen ☁️

Der Aufstieg cloud-nativer Technologien hat neue Einschränkungen für die Komponentenmodellierung eingeführt. Besonders serverlose Architekturen stellen traditionelle Vorstellungen von Komponentengrenzen in Frage. In serverlosen Umgebungen sind Komponenten oft ephemere Funktionen, die automatisch skaliert werden.

Die Modellierung dieser Systeme erfordert einen Fokus auf Zustandslosigkeit und ereignisgesteuerte Interaktionen. Das Diagramm muss den Ablauf von Ereignissen darstellen, anstatt die Persistenz von Zuständen. Diese Verschiebung beeinflusst, wie Teams die Datenspeicherung und Nachrichtenübertragung visualisieren.

Aspekte der Cloud-Native-Modellierung umfassen:

- Zustandsverwaltung: Festlegen, wie externer Zustand gespeichert wird, wenn Komponenten selbst zustandslos sind.

- Skalierungsrichtlinien: Anzeigen, wie Komponenten auf Änderungen der Last reagieren.

- Verwaltete Dienste:Darstellung von Drittanbieterdiensten als Black-Box-Komponenten.

Architekten müssen die Einschränkungen des Cloud-Anbieters verstehen. Modellierungstools müssen diese Einschränkungen abstrahieren, bleiben aber genau genug, um die Implementierung zu leiten. Dieses Gleichgewicht stellt sicher, dass das System portabel ist, ohne die Leistung zu opfern.

Standardisierung und Interoperabilität 📏

Je komplexer die Systeme werden, desto größer wird die Notwendigkeit nach standardisierten Modellierungssprachen. Die Interoperabilität zwischen verschiedenen Tools und Plattformen stellt sicher, dass Modelle zwischen Teams und Organisationen geteilt werden können. Dies ist entscheidend für große Unternehmen mit vielfältigen Technologiestack.

Offene Standards verhindern Vendor Lock-in und ermöglichen es Teams, Werkzeuge zu wechseln, ohne ihre architektonischen Dokumentationen zu verlieren. Branchenorganisationen arbeiten an Formaten, die sowohl visuelle Darstellung als auch maschinenlesbare Daten unterstützen.

Wichtige Aspekte der Standardisierung umfassen:

- Gemeinsame Datenformate:Verwendung offener Formate zum Austausch von Modelldaten.

- API-Integration:Definieren, wie Werkzeuge miteinander kommunizieren können.

- Versionsysteme:Sicherstellen der Abwärtskompatibilität in Modellformaten.

Die Einführung von Standards fördert die Zusammenarbeit zwischen Entwicklung, Betrieb und Sicherheitsteams. Es stellt sicher, dass alle von derselben architektonischen Definition ausgehen, wodurch Missverständnisse und Fehler reduziert werden.

Vergleich traditioneller vs. zukünftiger Ansätze

| Funktion | Traditionelle Modellierung | Zukünftige Modellierungstrends |

|---|---|---|

| Aktualisierungs-Häufigkeit | Manuelle, periodische Aktualisierungen | Kontinuierliche, automatisierte Synchronisierung |

| Genauigkeit | Niedrig, anfällig für Abweichungen | Hoch, Echtzeit-Validierung |

| Werkzeuge | Eigene Diagramm-Editoren | Integrierte IDE-Plugins |

| Fokus | Statische Struktur | Dynamisches Verhalten & Zustand |

| Sicherheit | Nach der Gestaltung hinzugefügt | In das Modell integriert |

Wichtige Trends und ihre Auswirkungen

| Trend | Auswirkung auf die Architektur |

|---|---|

| KI-gestütztes Design | Verringert die kognitive Belastung, verbessert die Mustererkennung |

| Mikrodienste | Erhöht die Komplexität, erfordert stärkere Grenzen |

| Cloud-nativ | Fordert zustandslose Gestaltung, ereignisgesteuerte Abläufe |

| Automatisierung | Beschleunigt die Bereitstellung, reduziert menschliche Fehler |

| Sicherheitsintegration | Stellt Compliance sicher, reduziert die Angriffsfläche |

Standardisierung und Interoperabilität 📏

Je komplexer die Systeme werden, desto größer wird der Bedarf an standardisierten Modellierungssprachen. Die Interoperabilität zwischen verschiedenen Tools und Plattformen stellt sicher, dass Modelle zwischen Teams und Organisationen geteilt werden können. Dies ist entscheidend für große Unternehmen mit vielfältigen Technologiestack.

Offene Standards verhindern Vendor-Lock-in und ermöglichen es Teams, Werkzeuge zu wechseln, ohne ihre architektonischen Dokumentationen zu verlieren. Branchenorganisationen arbeiten an Formaten, die sowohl visuelle Darstellung als auch maschinenlesbare Daten unterstützen.

Wichtige Aspekte der Standardisierung umfassen:

- Gemeinsame Datenformate:Verwendung offener Formate zum Austausch von Modelldaten.

- API-Integration:Definieren, wie Werkzeuge miteinander kommunizieren können.

- Versionsysteme: Sicherstellen der Abwärtskompatibilität in Modellformaten.

Die Einführung von Standards erleichtert die Zusammenarbeit zwischen Entwicklungs-, Betriebs- und Sicherheitsteams. Es stellt sicher, dass alle von derselben architektonischen Definition ausgehen, was Missverständnisse und Fehler reduziert.

In die Zukunft blicken 🔮

Die Zukunft der Komponentenmodellierung ist dynamisch und tief in den Entwicklungsprozess integriert. Sie entfernt sich von einer separaten Dokumentationsaufgabe hin zu einer zentralen Komponente im Ingenieurworkflow. Diese Veränderung stärkt Teams, um Systeme zu entwickeln, die robuster sind und sich leichter weiterentwickeln lassen.

Die aktuelle Lage dieser Trends erfordert ein Engagement für kontinuierliches Lernen. Teams sollten ihre aktuellen Modellierungspraktiken bewerten und Bereiche identifizieren, in denen Automatisierung oder Standardisierung Mehrwert bringen kann. Durch die Akzeptanz dieser Veränderungen können Organisationen ihre Fähigkeit verbessern, qualitativ hochwertige Software in einem sich schnell verändernden Umfeld bereitzustellen.

Die Reise hin zu fortgeschrittener Modellierung ist schrittweise. Sie beinhaltet die Verfeinerung von Prozessen, die Einführung neuer Werkzeuge und die Förderung einer Kultur der Genauigkeit. Während die Technologie weiterentwickelt wird, bleiben die Prinzipien klarer, wartbarer Architektur konstant. Die Werkzeuge werden sich ändern, aber der Bedarf an einem gemeinsamen Verständnis der Systemarchitektur wird bestehen bleiben.